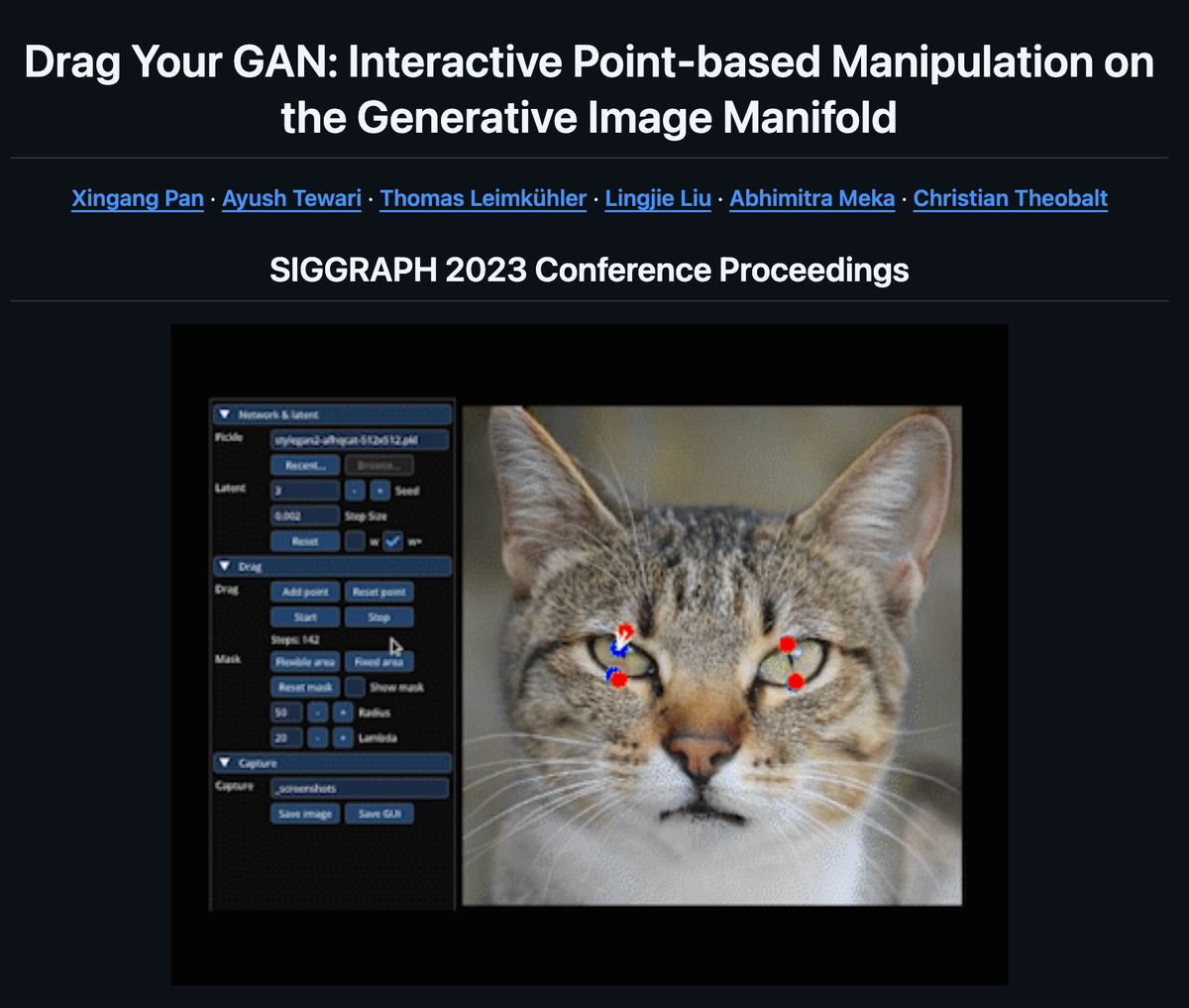

35.9k Star 开源神器,颠覆你的想象,指尖操控生成图像!

告别繁琐PS,只需拖拽,轻松驾驭GAN生成图像的强大力量

项目地址: https://github.com/XingangPan/DragGAN

DragGAN 是一款基于 GAN(Generative Adversarial Network,生成对抗网络)的图像交互式编辑工具。它允许用户通过指定图像上的“控制点”和“目标点”,然后拖动控制点,从而实现对图像的精准操控。想象一下,你可以轻松地改变动物的姿势、调整物体的形状,甚至改变人脸的表情,而这一切只需要简单的拖拽操作!

主要特点与功能:

- 交互式操控: 通过拖拽控制点,直观地编辑 GAN 生成的图像。

- 高精度编辑: 能够实现对图像细节的精确控制,例如改变眼睛的位置、调整嘴巴的弧度等。

- 多种平台支持:

- Linux: 提供了详细的 Docker 部署方案,方便用户在 Linux 环境下运行。

- Windows: 提供了 bat 脚本,方便 Windows 用户启动 GUI 界面。

- MacOS: 支持在 Silicon Mac M1/M2 芯片上利用 GPU 加速,也支持 CPU 运行。

- Web Demo: 提供了 OpenXLab 和 Huggingface 平台上的 Web Demo,无需配置环境即可体验。

解决了什么痛点?

传统的图像编辑软件操作复杂,需要专业的技能和大量的学习成本。而 DragGAN 的出现,降低了图像编辑的门槛,即使是没有任何专业背景的用户,也能轻松上手,创造出令人惊艳的图像编辑效果。 此外,传统的GAN模型控制粒度有限,DragGAN 实现了对 GAN 生成图像的更精准控制。

如何使用?

- 环境配置: 根据你的平台(Linux, Windows, MacOS)选择合适的配置方式,项目提供了详细的配置步骤。

- 模型权重准备: 项目提供了脚本帮助你预先权重。同时也支持 StyleGAN-Human 和 Landscapes HQ (LHQ) 数据集。

- 运行 GUI 或 Gradio Demo: 根据你的需求,选择运行 GUI 界面或 Gradio Demo。Gradio Demo 具有更好的跨平台性。

项目依赖:

- PyTorch

- CUDA (可选,用于 GPU 加速)

- StyleGAN3 (项目基于 StyleGAN3 开发)

其他信息

本代码基于 StyleGAN3 开发,部分代码借鉴了 StyleGAN-Human 项目。

协议

DragGAN 算法相关的代码遵循 CC-BY-NC 协议。 StyleGAN3 相关的代码遵循 Nvidia 源码协议。

怎么样,看完这个项目是不是觉得很棒? 这个项目对于设计师、创意工作者以及所有对图像编辑感兴趣的人来说非常有用! 快来转发给你的朋友们一起探索图像编辑的新纪元吧!