lllyasviel/FramePack:14.2k Star 开源神器,让视频扩散模型更实用!

突破显存限制,小白也能轻松驾驭的视频生成黑科技

项目地址: https://github.com/lllyasviel/FramePack

FramePack 是一款旨在让视频扩散模型更加实用的开源项目。它通过一种新颖的神经网络结构,实现了在消费级显卡上生成高质量视频,即使是笔记本电脑的 GPU 也能流畅运行。

该项目的核心在于其独特的 “帧打包” (Frame Packing) 技术,该技术将输入帧上下文压缩到固定长度,使得生成视频的工作量与视频长度无关。这意味着,即使要生成很长的视频,显存的压力也不会增加。

FramePack 的主要特点和优势包括:

- 节省显存: 即使使用 13B 参数的大模型,也仅需 6GB 显存即可运行,笔记本电脑 GPU 也能胜任。

- 高速生成: 在 RTX 4090 上,未优化时生成速度为 2.5 秒/帧,优化后可达 1.5 秒/帧。

- 支持多平台: 兼容 Linux 和 Windows 操作系统。

- 实时反馈: 采用逐帧预测方式,生成过程中即可看到视频效果,方便调整。

该项目解决了视频生成过程中显存消耗过大的痛点,让更多用户能够体验到视频扩散模型的强大能力。

快速上手

- 环境要求:

- Nvidia RTX 30XX, 40XX, 50XX 系列显卡 (支持 fp16 和 bf16)。

- Linux 或 Windows 操作系统。

- 至少 6GB 显存。

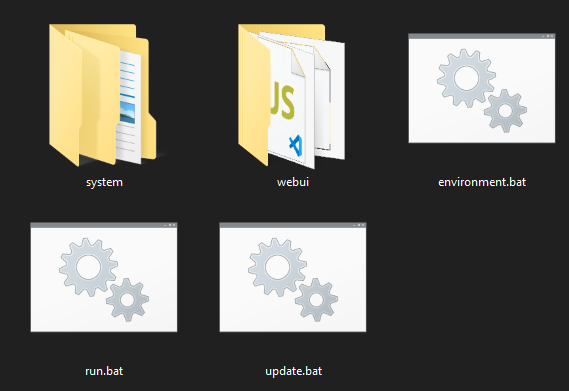

- Windows: 项目提供了一个一键安装包,包含 CUDA 12.6 和 PyTorch 2.6。解压后,运行

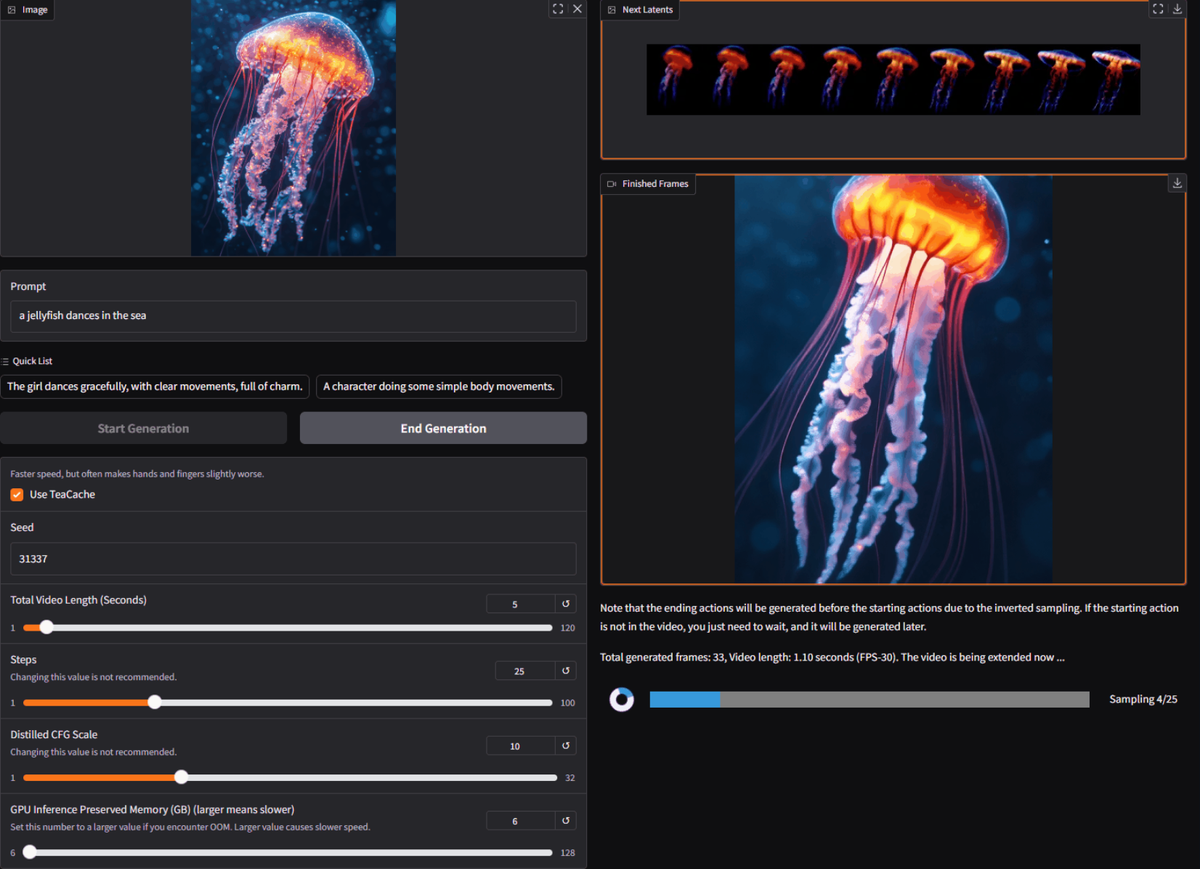

update.bat进行更新,再运行run.bat即可启动。 - 左侧上传图片并输入提示词 (prompt)。

- 右侧显示生成的视频和潜在预览。

- 视频将以逐帧方式生成,可以实时查看生成进度。

GUI 界面

Linux: 推荐使用独立的 Python 3.10 环境。首先,安装 PyTorch:

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu126

然后,安装其他依赖:

pip install -r requirements.txt

最后,运行 GUI 界面:

python demo_gradio.py

安装步骤

FramePack 旨在让视频扩散变得触手可及。

怎么样,看完这个项目是不是觉得很棒? 这个项目对于 想要探索视频生成,但又苦于设备限制的同学 来说非常有用! 快来转发给你的朋友们一起学习使用吧!